デジカメの画像処理、2回目は光を感じるイメージセンサーの話です。光を信号データに変える需要な部品の一つですが、カメラならではのからくりもあるのです。

関 連

意外と奥が深い:デジカメの画像処理(1)

色を感じないイメージセンサー:デジカメの画像処理(2)

RAWはスッピン:デジカメの画像処理(3)

イメージセンサー、色は感じない

イメージセンサーは、シリコン半導体からなる光検出器(光ダイオード)です。 光があたると、電子が生成され、その流れで電流が発生します。電流は光の強さに比例します。簡単に言えば、最近増えているLED(発光ダイオード)と逆の現象ですね。

イメージセンサーは光の強弱を感じることはできるのですが、光の波長(色)を感じることはできません。この意味では、モノクロポジフィルムに似ています。

そこで色を識別するため、R(レッド)・G(グリーン)・B(ブルー)の、特定の波長しか透過しないフィルターをかけて、画素ごとに1色分だけの光の強さを記録します。

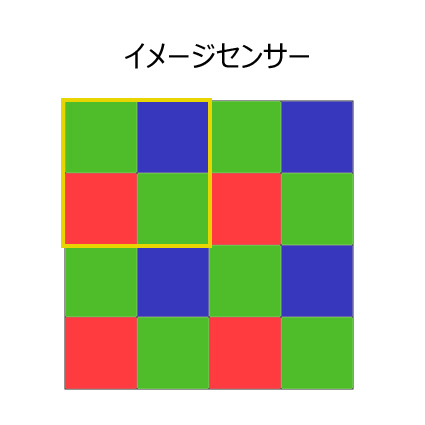

ちなみに、人の目は波長500nmあたりの緑色に対する感度が高いため、緑成分を多く取り込める配置とされています(下図)。RGBを1:2:1で並べたものが多く、コダック社のBayerさんが開発したことから、Bayer(ベイヤー)配列と呼ばれています。

左上で黄色く囲んだように、正方形の4つの画素(GBRG)で1組とすると、これで全ての色を表すことができます。

画素は色を感じることができないため、3色のフィルターをかけて、1つの色の「光の強弱」だけを感じるようになっています。 左上で黄色く囲んだ正方形の4つの画素(GBRG)で全ての色を表すことができます。

カメラの画素数、実際は4分の1

パソコンのディスプレイでは、ひとつの画素は、RGBそれぞれの色について8ビット(合計24ビット)の濃淡情報を持っています。つまり、ひとつの画素では、3つの色で、256^3=16,777,216色(約1700万色)が表現できることになります。これは、フルカラー画像と呼ばれています。

実際には、画面の1画素は、RGBの3ドット(サブピクセル、副画素)から構成され、1つの画素には、全ての色情報が含まれていることになります。

一方、デジタルカメラの場合、ひとつの画素は一つの色しか感じることができないため、画素(ピクセル)と表示しているのは、実はサブピクセルのことになります。

例えば、α7RIIは約4200万画素の記録画素数と謳っていますが、これはサブピクセル数になります。よって、4つのサブピクセルで1つのピクセル(画素)とすると、実際の画素数は4分の1の約1000万画素になってしまいます。

こうすると、4つの画素の1セットで初めて全ての色を測っていることになり(1つの画素では全ての色を測定していることにならない)、1回めで紹介した標本化定理に従います。また、PCディスプレイなどの表示とも整合性が出てきます。

撮影時には、記録画素数が実質的に4分の1になるわけですが、画像ファイルとして記録する時には、復活します(笑)。

モノクロ撮影の場合

モノクロで撮影すると、全部の画素で白黒情報を得られるのではないかと思いますが、カラー用のイメージセンサーなので、今までと同じく、デジタル信号はカラー情報として記録しています。

SONY の場合、モノクロモードは、ピクチャスタイルの一つに過ぎません。クリエイティブスタイル/白黒を選択します。ファインダーや液晶の表示はモノクロになります。RAW+JPEGで撮ると、JPEGはモノクロですが、RAWファイルはカラーです。

補間処理(デモザイク)

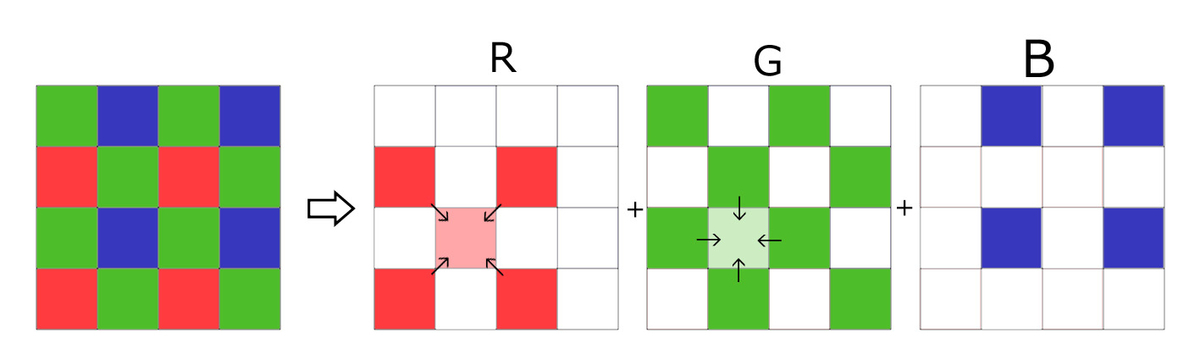

上で示したように、3色の色ごとにフィルターで分けるため、ひとつの画素は、RGBどれか1色分の情報しか持たないことになります。

そこで、多くのデジカメでは、JPEGの映像ファイルにする段階やRAWデータの現像段階で、足りない2色分の色情報について、周辺画素の情報から補間処理(デモザイク)を行っています。

例えば、下図の左下の青の画素は、青色の情報しか得られません。そこで近接する赤の画素情報から自分の赤色を推定し、また近接する緑の画素情報から自分の緑色を推定します。そして、自分の青色の情報を合わせて、全ての色のカラー情報とするのです。

よって、1つの画素はRGB全ての色の情報を含むことになります。サブピクセル数とピクセル数が一致し、記録画素数と画面での表示画素数が一致するわけです。

こうすると、有効画素数は増える(メーカー公表値に戻る)のですが、1つの画素のRGBの色情報のうち、2/3は補正データということになります。

1つの画素では、RGBどれか1つの色情報しか得られません(左)。そこでRGBに分離(色分離)し、それぞれの色について、近接する画素の色情報から補間処理することで、1つの画素が全ての色の情報を持つこと(RGB同時化)になります。

なお、SONYのαシリーズでは、RAWファイルに対しても、JPEGと同じ方法で補間処理が行われています。問い合わせて確認しました。

また、SONY の α7RIIIになると、ピクセルシフトマルチ撮影というのがあって、画素をずらしながら連続して4枚撮影し、全ての画素でR・G・B の全色情報を取得するので補間処理が不要です。ただし、3脚が必須で、また、純正のソフトウェアでしか現像できません。

ここまでのまとめ

イメージセンサーは、色を感じることができません。そこで、3色のフィルターをかけて、1つの画素は1色分だけの情報を記録し、4つの画素1組で全ての色を感じる仕組みになっています。そのため、カメラの実質的な画素数は、メーカー公表値の4分の1になってしまいます。

ただし、最終的にJPEG記録では、足りない色情報を補正するというワザを使って、1つの画素は全ての色情報を持つようになります。総画素数としてはメーカー公表値に戻るんですが、1つの画素の色情報の2/3は補正データということになりますね。